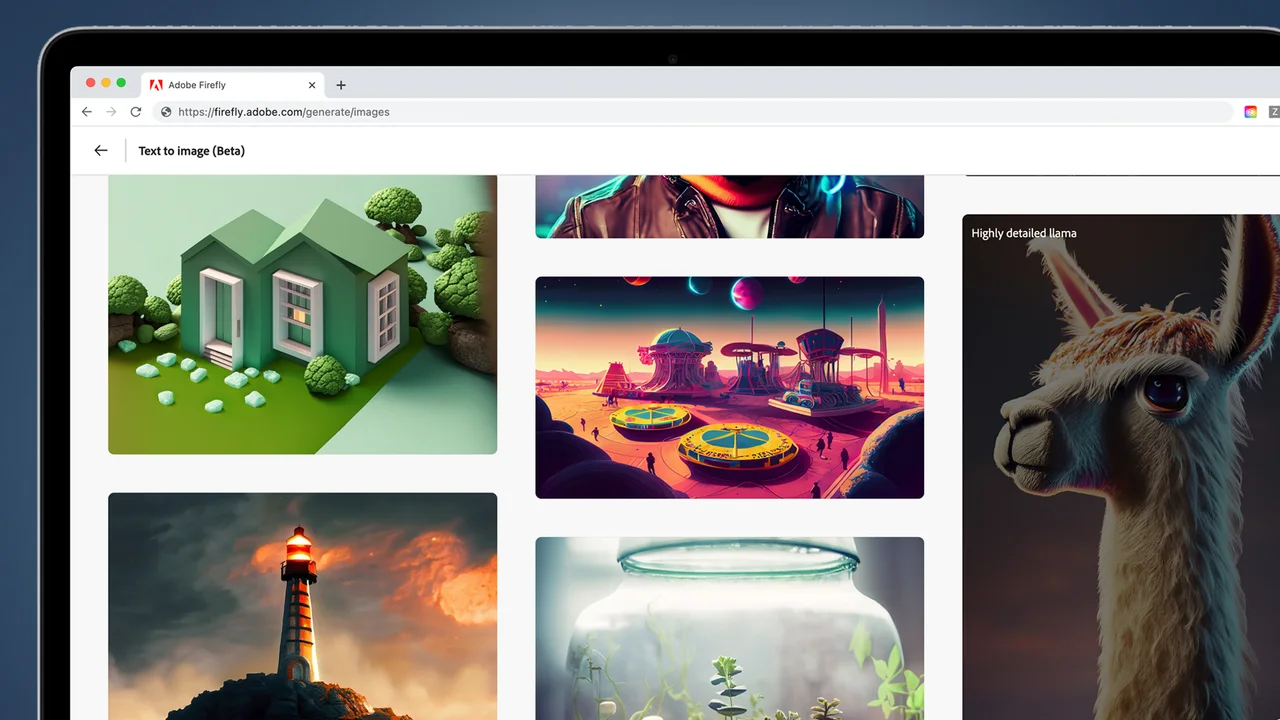

OpenAI’ın, Kanada’da meydana gelen trajik bir okul saldırısına ilişkin riskli işaretleri önceden fark etmiş olabileceği, ancak herhangi bir resmi adım atmadığı iddia edildi. “OpenAI polis ikilemi” olarak tanımlanan bu durum, şirketin kullanıcı gizliliğini koruma yükümlülüğü ile kamu güvenliğini sağlama sorumluluğu arasındaki hassas dengeyi yeniden gündeme taşıdı.

The Wall Street Journal’ın özel haberine göre, saldırıyı gerçekleştiren kişinin ChatGPT üzerinden yaptığı tehlikeli içerikli yazışmalar, olaydan aylar önce şirket sistemleri tarafından tespit edildi.

OpenAI Polis İkilemi Nedir, Nasıl Gündeme Geldi?

Süreç, Kanada’daki okul saldırısını gerçekleştiren Jesse Van Rootselaar’ın ChatGPT üzerindeki mesajlaşmalarıyla başladı. OpenAI’ın zararlı içerikleri belirlemek amacıyla kullandığı otomatik güvenlik mekanizmaları, söz konusu yazışmaları olası bir risk olarak işaretledi. Bunun ardından ilgili kayıtların, şirket bünyesindeki birden fazla çalışan tarafından detaylı şekilde incelendiği belirtildi.

İddialara göre şirket içinde konuya ilişkin yoğun bir görüş ayrılığı yaşandı. Bazı çalışanlar, yazışmalarda açık bir fiziksel şiddet riski bulunduğunu öne sürerek durumun derhal Kanada’daki güvenlik birimlerine bildirilmesi gerektiğini savundu ve yönetime bu yönde çağrıda bulundu. Ancak bu girişimlerin karşılık bulmadığı, nihai kararın yetkililere bildirim yapılmaması yönünde olduğu aktarıldı.

OpenAI’dan Konuya İlişkin Resmi Değerlendirme

OpenAI adına açıklama yapan bir şirket sözcüsü, olayın ciddiyetle ele alındığını ve ilgili kişinin hesabının kapatıldığını doğruladı. Ancak sözcü, söz konusu içeriklerin emniyet birimlerine bildirim yapılmasını gerektirecek eşiği karşılamadığı yönünde değerlendirme yapıldığını belirtti. Şirket politikalarına göre bir kullanıcının yetkililere ihbar edilmesi için paylaşımların “ciddi ve yakın bir tehdit” niteliği taşıması gerekiyor.

Yaşananlar, yapay zekâ şirketlerinin etik sorumlulukları ile hukuki yükümlülükleri arasındaki dengeyi yeniden tartışmaya açtı. Kullanıcı gizliliğinin korunması ile olası suçların önlenmesi arasındaki hassas çizgi, teknoloji sektörünün önündeki en karmaşık meselelerden biri olarak öne çıkıyor.

Görsel Kaynak:https://shiftdelete.net/chatgpt-teroru-engelleyebilir-miydi

Kaynak:https://shiftdelete.net/chatgpt-teroru-engelleyebilir-miydi